news

“Kimi”的背后是中国大模型技术引领者

2024/03/22

自2022年11月OpenAI发布ChatGPT以来,AI风口席卷全球,国内外科技巨头都纷纷布局,加入到这场全球新一轮 AIGC 技术竞赛,微软以股权投资OpenAI的方式,获得GPT技术授权推出Copilot服务,Google发布 Bard及升级版Gemini,Apple放弃造车业务全面投入AI怀抱。资本不断地涌入AIGC,AI初创公司Anthropic、Cohere、Coreweave、Inflection AI估值都在50亿美元以上。

在这场AI竞赛中,来自中国的一家名为月之暗面(Moonshot AI)的初创公司引发A股热潮,公司目标主攻AGI,最新一轮估值在25亿美元左右,这是国内AI有史以来最大的单轮融资,也使得月之暗面一跃成为中国AI大模型的第一梯队选手。公开信息显示,月之暗面 (Moonshot AI) 创立于2023年3月,致力于寻求将能源转化为智能的最优解,通过产品与用户共创智能,2023年10月推出全球首个支持输入20万汉字的智能助手产品Kimi。2024年3月19日,发布了200万字上下文窗口的Kimi模型,使其能够完成更长和更复杂的任务。

1

优秀的团队背景

初创公司之所以能够吸引知名机构的疯狂追捧,其优秀的团队背景必定是重要因素之一。在这方面,月之暗面无疑让投资人毫不迟疑,创始成员堪称全明星豪华阵容。

创始人杨植麟是典型的学霸,目前任职于清华大学交叉信息学院助理教授(研究方向:大规模预训练,自然语言处理,自然语言理解与生成,少样本学习,零样本学习,多模态学习),其本科毕业于清华大学,博士毕业于卡内基梅隆大学,师从苹果 AI 研究负责人 Ruslan Salakhutdinov 和谷歌首席科学家 William Cohen。博士期间,杨植麟先后以一作身份,发表 Transformer-XL 和 XLNet 两项工作,谷歌学术被引次数近两万。Transformer-XL 成为首个全面超越 RNN 的注意力语言模型,论文成为 NeurIPS 2019 与 ACL 2019 的最高引论文之一;XLNet 则在 20 项任务上超越谷歌 BERT 模型,一鸣惊人。根据 GitHub 上的个人资料,杨植麟曾在 Google 和 Meta Platforms 的人工智能实验室工作。在创立 Moonshot AI 前,杨植麟还与他人共同创立了循环智能(Recurrent AI),红杉中国也对该公司进行了投资。据该公司网站称,Recurrent AI 为销售人员开发工具。杨植麟的学术和创业实践背景,让 Moonshot AI 成为了投资机构追逐的明星项目。

除了杨植麟,月之暗面的创始团队成员还包括周昕宇、吴育昕、张宇韬、汪箴等也值得关注。周昕宇是杨植麟在清华的本科同学,他在大学毕业后加入旷视,研究算法量产,就职期间,他和旷视研究院基础科研负责人张祥雨一道,研究移动端模型,以共同一作的身份撰写 ShuffleNet 中了 CVPR 最佳论文。吴育昕同样毕业于清华大学,以及卡内基梅隆大学,大学毕业后在Meta的人工智能研究院工作。张宇韬本硕均在清华大学计算机系就读。他的研究方向是异构数据融合和知识图谱构建,在KDD、CIKM等计算机顶会上发表多篇文章。他作为技术负责人,参与了科技大数据分析平台AMiner的研发。汪箴则毕业于复旦大学计算机科学系,后就读新加坡南洋理工大学计算机工程系,主要研究工作面向AI在鉴证科学上的应用。此前,他曾在Google担任高级软件工程师/技术主管,开发移动端网页搜索、社交平台等产品。后又担任新加坡AI技术驱动独角兽领创集团(ADVANCE.AI)技术委员会负责人/技术副总裁,还有过投资机构的从业经历。

2

技术亮点:长文本输入

评价一个AI,一个是单次和模型对话能够输入的文本-长文本输入能力,二是多模态能力,三是输出结果的准确度。长文本输入技术极大地增强了大型语言模型的处理能力,允许AI更深入地理解复杂的文本结构和丰富的上下文信息,从而提供更精准的分析和生成内容。目前公开可用的LLM中Claude 3能够单次处理超过15万英文单词,GPT-4 Turbo的上下文窗口为128k能够单次处理9.6万个英文单词,Gemini 1.5能够稳定处理的信息量高达100万个tokens相当于70万个单词。

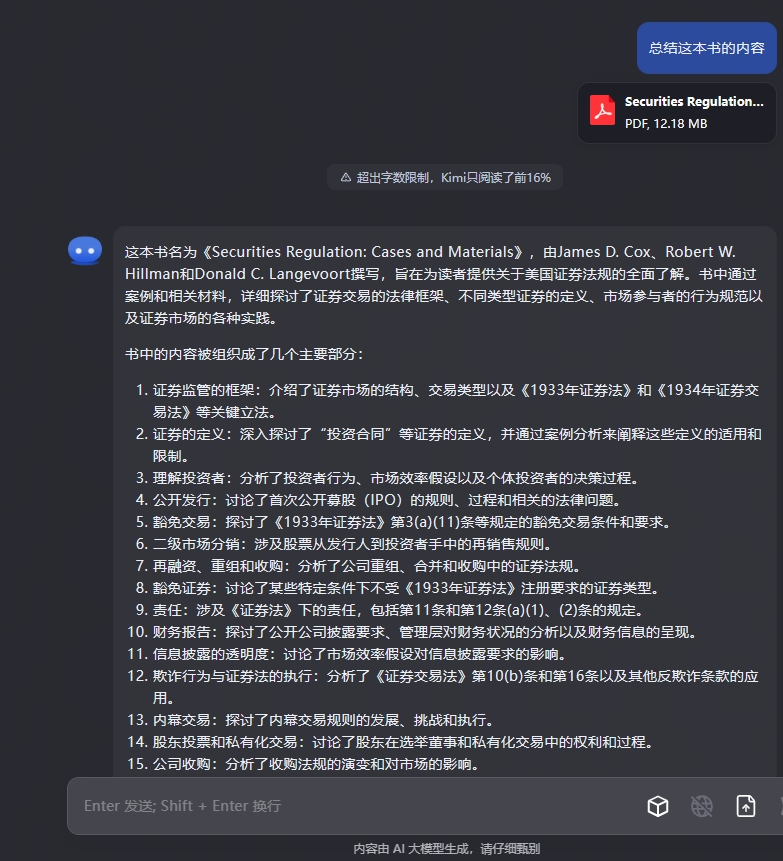

而月至暗面推出的Kimi智能助手,最亮眼的当属它在跨模态超长文本理解能力上的大幅突破,其支持200万字上下文窗口,这相当于4本专业书,此次Kimi已在窗口长度上成功碾压所有大模型。更大的查询窗口在具体实际场景中会非常有用,电影制作人可以上传他们的整部电影,询问Kimi是什么意见,公司可以使用Kimi审查大量的财务记录,学生可以上次整本专业书,询问Kimi书中的各种论点。可以说KIMI对超长文本强大的分析推理能力是其它大模型做不到的。

基于20万字长文本输入

3

商业模式:专注于to C

大模型有ToB和ToC两个不同的阵营,不同于国内其他大模型玩家热衷于“赋能toB”的思路,月之暗面另辟蹊径,将toC作为发展重点。正如杨植麟在谈到月之暗面愿景时所说的那样,“月之暗面想通过AI给个人提供更便捷,更强大,更个性化的普惠产品”。

杨植麟在专访中表示:我们做 ToC 其实还是以终为始来看这个问题。我们最终想去探索智能边界,想让它真正有用,想去做个性化。以终为始去讨论的话,最终需要的一个很重要的东西,是能够有非常快速的迭代效率,不管是在技术、还是产品侧能够去快速去推进。所以迭代效率可能是我们现在最重要的一个关键词。那迭代效率的话,我觉得 ToC 是一个非常自然的选择。它会决定你的企业文化、他会决定你的人才结构、他也会决定你最终到底是用什么样的思路、做出来什么样的事情。所以把这几个维度加起来,你发现其实只有 ToC 这一条路。而且,每个时代,当有新的技术变革时,都会产生很多新的 Super APP。从市场的存在性的角度来讲,我觉得大模型赛道大概率也会出现,所以这是我们现在最关注的一个方向。

结 语

目前,Kimi智能助手和传统打法无异,以免费的方式吸引用户和使用量,现行抢占用户,未来也不排除进行商业化,推出收费版本。对于长文本输入的优势,早在Gemini1.5发布时,Google已成功测试了高达1000万tokens,相当于一次将整个《指环王》三部曲放进去,换成文字就是700万。对于大模型来说,重要的不是声明中实现多少上下文长度的神话,而是模型实际上如何使用上下文来解决现实世界的问题,期待国产模型未来有更多的进步。